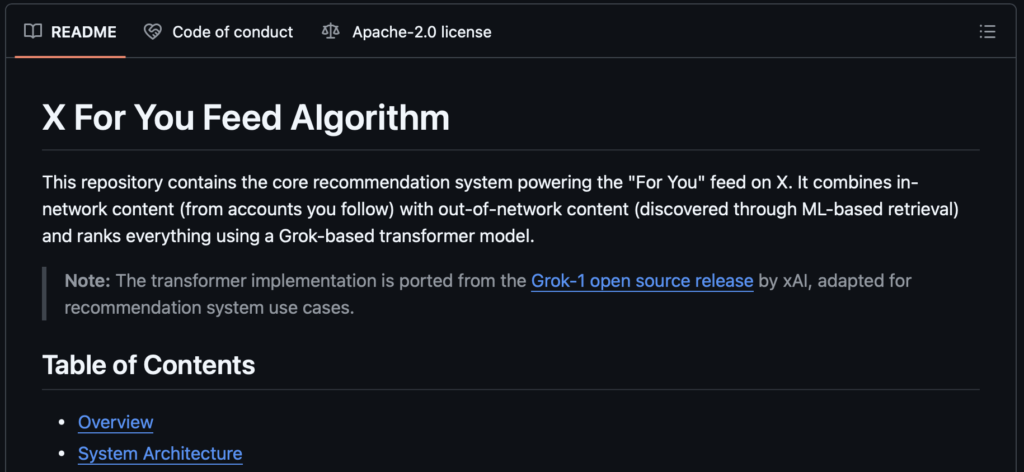

Quando Elon Musk ha reso pubblico nel gennaio 2025 il codice dell’algoritmo di X, non immaginava forse di consegnare al mondo la formula matematica della polarizzazione politica. La formula semplificata è brutale nella sua chiarezza: Like × 1 + Retweet × 20 + Risposte × 13.5 + Clic sul profilo × 12 + Clic sui link × 11 + Salvataggi × 10. Un algoritmo progettato per massimizzare l’engagement che ha creato qualcosa di diverso: un’economia della rabbia.

La matematica del conflitto

I numeri raccontano una storia inquietante. Una risposta vale 13.5 volte di più di un like, mentre un retweet ha un peso 20 volte superiore. Il disaccordo diventa letteralmente 27 volte più prezioso del consenso. I segnali negativi – “Non mi interessa”, blocchi, mute e segnalazioni – hanno un peso di circa -74 volte, ma il danno è già fatto: il contenuto controverso ha già accumulato punti sufficienti per la distribuzione di massa.

La conseguenza è un sistema che non calcola la verità, ma il calore. La chiave è la profondità della conversazione: tutto il resto diventa secondario. Un post che genera dibattito acceso supera sempre uno che raccoglie consenso silenzioso. È la matematica applicata alla psicologia di massa.

L’economia dell’indignazione

Questa formula ha trasformato il dibattito pubblico in un mercato dove l’indignazione diventa merce di scambio. Nel 2024, la sezione “Per te” di X mostrava il doppio di contenuti pro-Trump rispetto a quelli pro-Harris per i nuovi account, segnale di come l’algoritmo privilegi naturalmente i contenuti più divisivi.

La ricerca di Northeastern University ha dimostrato che in una sola settimana, le modifiche algoritmiche possono spostare i sentimenti verso il partito opposto di due punti – un effetto normalmente osservato nell’arco di tre anni. I risultati sono validi indipendentemente dal partito di appartenenza dell’utente.

La ricerca della polarizzazione

Quando l’esposizione a contenuti antidemocratici aumenta, i sentimenti verso l’altro schieramento politico si raffreddano di oltre 2 gradi su una scala da 0 a 100. È quanto emerso da uno studio pubblicato su Science che ha utilizzato un’estensione del browser per modificare in tempo reale i feed degli utenti.

Ma c’è un paradosso: dal 1996 al 2012, la polarizzazione politica è aumentata maggiormente nei gruppi demografici meno propensi all’uso di internet e social media, gli adulti oltre i 75 anni. Questo suggerisce che la polarizzazione precede gli algoritmi, ma gli algoritmi l’amplificano.

Il prezzo della trasparenza

La pubblicazione del codice di X ha scatenato reazioni contrastanti. “È necessariamente incompleto, che è il modo in cui funziona tutta la disinformazione”, ha dichiarato il CEO di Glitch Anil Dash. La trasparenza senza contesto rischia di diventare teatro dell’algoritmo.

Eppure, questa apertura ha un valore. Permette alla ricerca indipendente di studiare fenomeni che prima erano accessibili solo alle piattaforme stesse. “Gli algoritmi dei social media dirigono la nostra attenzione e influenzano i nostri stati d’animo e atteggiamenti, ma fino ad ora solo le piattaforme avevano il potere di cambiare il design dei loro algoritmi”, spiega Martin Saveski dell’Università di Washington.

Leggi anche Meta Moltbook: acquisito il social di soli bot AI

Verso algoritmi più umani

La soluzione non è eliminare gli algoritmi – l’utente medio di X vede solo 20-30 post al giorno nel feed – ma riprogettarli. Un algoritmo che promuove il dialogo politico genuino ha meno probabilità di polarizzare rispetto a uno che promuove la demagogia.

Il futuro potrebbe essere nelle mani degli utenti stessi. I ricercatori hanno reso disponibile il codice del loro strumento perché altri possano creare i propri sistemi di classificazione indipendenti dall’algoritmo delle piattaforme social. Non si tratta di censurare, ma di scegliere: avere il controllo su cosa vedere, quando vederlo e perché.

La formula di Musk ha rivelato la meccanica nascosta della polarizzazione digitale. Ora tocca alla società decidere se accettare questa matematica del conflitto o scriverne una nuova.